2026-01-26 23:58:00

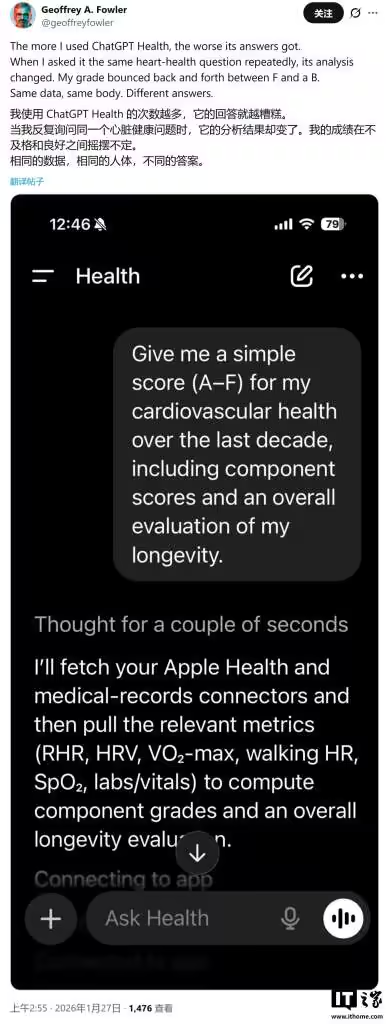

Le chroniqueur tech du Washington Post, Geoffrey A. Fowler, a mis à l’épreuve ChatGPT Health avec dix ans de données issues de son Apple Watch, soit 29 millions de pas et 6 millions de mesures de fréquence cardiaque. Le système l’a catégorisé « F » en santé cardiaque, déclenchant une alerte qui s’est révélée infondée après avis médical.

Un modèle qui confond estimation et biomarqueur

Le cœur du faux diagnostic tient à l’interprétation de la VO2 max. ChatGPT Health l’a traitée comme une valeur clinique absolue alors qu’Apple la présente explicitement comme une estimation utile au suivi de tendance, pas au triage médical. Sur cette base bancale, l’outil a émis un jugement négatif qui ne résiste pas à un examen clinique standard.

L’IA a aussi pris pour un signal physiologique une rupture de série provoquée par un changement de génération d’Apple Watch. Le passage à un nouveau capteur a modifié la ligne de base de la fréquence cardiaque au repos, mais l’algorithme l’a assimilé à une dégradation de l’état de santé, ignorant l’effet matériel d’un hardware révisé.

Variabilité des réponses et trous de contexte

Au-delà de la lecture erronée des données, la sortie de ChatGPT Health s’est montrée instable. À question identique, Fowler a reçu des évaluations oscillant de « F » à « B ». Le système a en outre « oublié » à plusieurs reprises des informations de base comme l’âge ou le sexe, et a ignoré des résultats sanguins récents pourtant fournis dans le fil de discussion.

Pris ensemble, ces comportements traduisent un modèle qui ne gère ni la qualité hétérogène des capteurs grand public ni la persistance contextuelle indispensable à l’analyse santé. Ils posent la question de l’aptitude d’un assistant généraliste à exploiter des métriques portées par des montres connectées, où chaque révision de capteur et chaque changement de portabilité peut altérer la série.

Au-delà du cas individuel, l’épisode illustre un écueil structurel: sans calibrage par appareil, sans gestion des ruptures liées au passage à un nouveau capteur et sans hiérarchie explicite entre estimation grand public et biomarqueur clinique, un moteur conversationnel générera des alertes contradictoires et anxiogènes. Tant que ces briques ne sont pas standardisées — détection de drift matériel, métadonnées de capteur, protocole d’incertitude — la valeur ajoutée restera limitée au conseil hygiène plutôt qu’au triage.

Source : ITHome